-

Wie viele Megapixel braucht eine Kamera?

Wie viele Megapixel braucht eine Kamera?

Kurz Zusammengefasst: Ihre Kamera braucht gerade so viele Pixel, wie für ihr Medium(Bildschirm, DIN A4 Druck) notwendig ist. Stellen Sie ihre Bilder auf einem 4K-Bildschirm dar und drucken maximal DIN A3, reichen schon 12 Megapixel völlig aus.

Wieso mehr Pixel trotzdem sinnvoll sein können, findet ihr hier in diesem Artikel.

Megapixel-Wars – Der Angriff der Bildriesen

Seit dem kommerziellen Durchbruch der digitalen Fotografie besteht ein unumstrittener Megapixel-Krieg zwischen allen großen Kameraherstellern. Federführend sind dabei Hasselblad und Phase One mit ihren über 100 Megapixel schweren Mittelformat-Sensoren sowie Sony, Canon und Nikon mit Vollformat-Sensoren mit über 50 Megapixeln.

Bevor wir allerdings an die Strategie der Hersteller gehen, müssen wir einmal klären wie ein Kamera-Sensor genau funktioniert.

Die Basics – Das 1 Mal 1 eines Lichtbildsensor

Ein Kamera-Sensor ist vergleichbar mit einem Mikrofon.

Eine Schallwelle trifft auf die Membran eines Mikrofons. Die Membran wandelt die Schallwelle in eine elektrische Spannung um, welche in einem Verstärker verstärkt wird.

Dieses verstärkte Signal wird in einer Soundkarte von einem analogen Signal in ein binäres System eines Computers mit Nullen und Einsen übersetzt.

In einer Kamera passiert das Gleiche. In einer Kamera trifft allerdings eine Lichtwelle auf einen Kamerasensor und anstatt eines Soundprozessors wird ein Bildprozessor genutzt.

Kamerasensoren haben aber eine Besonderheit: – Sie sind eigentlich farbenblind!

Strahlende Farben dank Bayer-Matrix

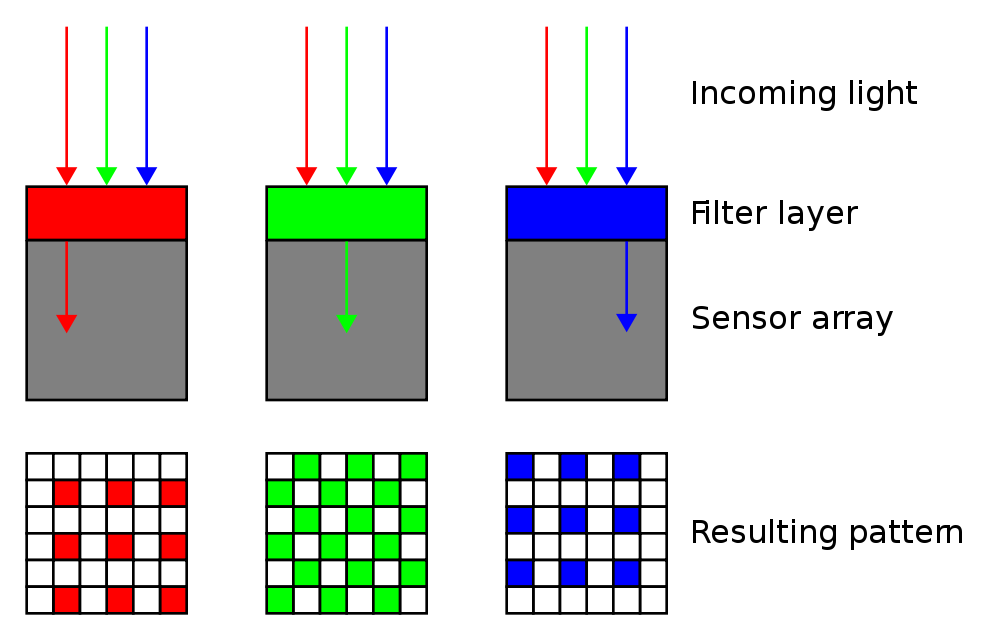

Dank einem Mitarbeiter bei Kodak mit Namen Bryce E. Bayer, müssen wir uns glücklicherweise nicht mit Schwarzweiß-Bildern begnügen.

Herr Bayer kam auf die pfiffige Idee über jeden Pixel der Kamera einen Farbfilter zu legen, wodurch jeder Bildpunkt nur eine einzige Farbe aufzeichnet.

Der Bildprozessor nimmt dabei jeweils die Daten von mehreren benachbarten Pixeln und errechnet für jeden Pixel seinen Grün-/Rot-/Blau- und Helligkeitswert.

Aus dieser Schummel Leistung, generiert der Bildprozessor am Ende das gesamte Foto.

Mikrolinsen – Tiefpassfilter – Hochpassfilter – Farbfilter – Und Co

Damit das Licht allerdings sauber auf jedes Feld unseres Schachbrettmutters fallen kann, ist einiges an Technik notwendig.

Zuerst müssen die durch das Objektiv eintreffenden Lichtstrahlen voneinander getrennt werden, um eine Vermischung von Farben zu vermeiden.

Hierfür nutzt die Industrie extrem kleine Mikrolinsen, die das Licht über einem Pixel bündeln.

Nach der Bündelung werden zusätzlich Tiefpass- und Hochpassfilter eingesetzt, um für Menschen nicht sichtbare Licht-Frequenzen herauszufiltern.

Die Pixellüge

Wie wir nun wissen, zeichnet jeder Pixel der Kamera nur eine Farbe oder die Helligkeit auf.

Damit wir ein vollständiges Foto sehen können, benötigen wir aber für jeden Pixel im finalen Bild alle Farb- und Helligkeitswerte.

Deshalb fasst eine Digitalkamera die Werte von 4 Pixeln auf einem Sensor zu dem Wert von einem Bild-Pixel zusammen.

Eine Kamera mit der Angabe 24 Megapixel, hat deshalb eigentlich nur 6 Megapixel an Auflösung.

Damit die Bild-Datei am Ende jedoch ihre versprochenen 24 Megapixel hat, wird das Bild interpoliert und Pixelwerte hinzugerechnet.

„Viel hilft Viel“ oder „Weniger ist Mehr“?

Mehr Pixel versprechen mit mehr Farb- und Helligkeitsinformationen eine bessere Bildqualität.

Leider macht einem hier die Fertigungstechnik und zum Teilen auch die Physik einen Strich durch die Rechnung.

Fertigung der Sensoren

Je kleiner ein Bauteil wird, desto komplexer wird seine Fertigung. Bei einem Vollformatsensor einer Nikon D750 mit 24 Megapixel sprechen wir hier von einer Pixelgröße von 6 Mikrometer oder anders ausgedrückt 0,006 mm. Das klingt im ersten Moment winzig, aber in der Welt von Kamerasensoren sprechen wir hier von riesigen Pixeln.

Apple bringt in einem iPhone Xs auf einer Fläche von nur 7,01 x 5,80 mm stolze 12 Megapixel unter.

Daraus ergibt sich eine Pixelgröße von nur noch 1,2 Mikrometer! Der Pixel unserer Nikon D750 ist somit 5 Mal größer, als in einem iPhone. Damit dürfte auch auf der Hand liegen, weshalb eine Spiegelreflex-Kamera immer eine bessere Bildqualität besitzen wird als ein Smartphone.

Der Bildpunkt – Ein Lichteimer

Warum die Miniaturisierung ein Problem ist?

Ein Pixel fungiert wie ein Regenmesser. Je mehr Licht in unseren Messbecher/Pixel fällt, desto mehr Helligkeit registriert unser Pixel. Je größer die Fläche des Messbereiches ist, desto genauer wird die Messung. Gleichzeitig muss das Signal auch weniger verstärkt werden, da mehr Licht auf dem Pixel eine Spannungsveränderung verursachen.

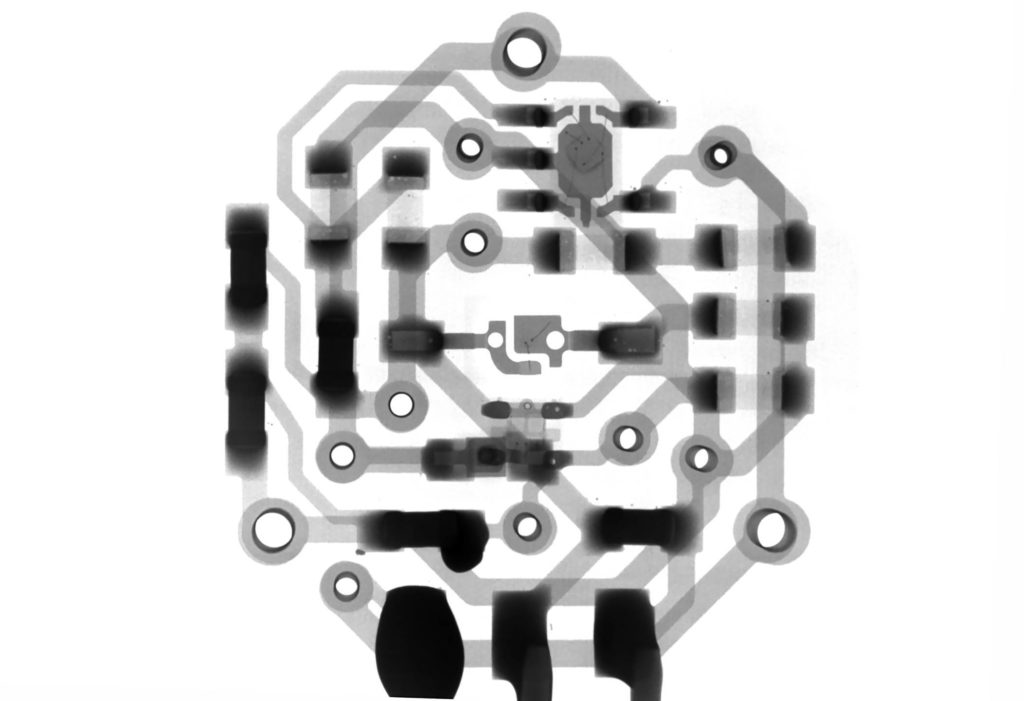

Unser Messbecher/Pixel fängt das Licht allerdings nicht ungestört auf.

Bei herkömmlichen Kamerasensoren verlaufen über der Messoberfläche zahllose Leiterbahnen, die jeden Pixel mit Strom versorgen und das Signal des Pixels zum Bildprozessor transportieren. Diese Leiterbahnen bedecken circa 1/3 der Gesamtoberfläche eines Kamerasensor.

Prinzipiell können diese Leiterbahnen auf der Rückseite des Sensor verlaufen. Dieses Verfahren ist allerdings sehr kostspielig und wird bisher nur von Sony genutzt.

Durch die zahlreichen Störungen der Pixel und der extrem geringen Spannungsausschläge von winzigen Pixeln, ist das Bildrauschen bei Sensoren mit hoher Pixeldichte stärker ausgeprägt als es bei Kameras mit großen Pixeln der Fall ist.

Diese Signalstörungen sehen wir allerdings nicht nur als Rauschen im Bild.

Sie betreffen vor allem die feinen Nuancen eines Bildes. Feine Farb-, Helligkeitsabstufungen verschwinden im Bildrauschen.

Pixelsterben – Dead Pixel und Hot Pixel

Die Miniaturisierung hat aber noch mehr Folgen: Sie fördert das absterben von Pixeln. In der Fotografie spricht man hier von Dead Pixeln.

Dies sind Pixel, bei denen die Leiterbahn durch Alterung, Abnutzung oder Produktionsfehler defekt oder fehlerhaft ist. Dadurch kann der Pixel keine Informationen mehr an den Bildprozessor weitergeben. Neben den Dead Pixeln gibt es auch noch sogenannte Hot Pixel. Bei diesen Pixeln ist die Leiterbahn ebenfalls beschädigt, wodurch Sie immer den maximalen Helligkeitswert an den Bildprozessor weitergeben.

Bildprozessoren und Bildverarbeitungssoftware wie z.B. Lightroom, Photoshop oder Capture One rechnen diese kaputten Pixel mittlerweile zwar direkt aus dem Bild heraus, was aber bleibt sind fehlende Informationen im Bild.

Objektive und ihre Auflösungsgrenze

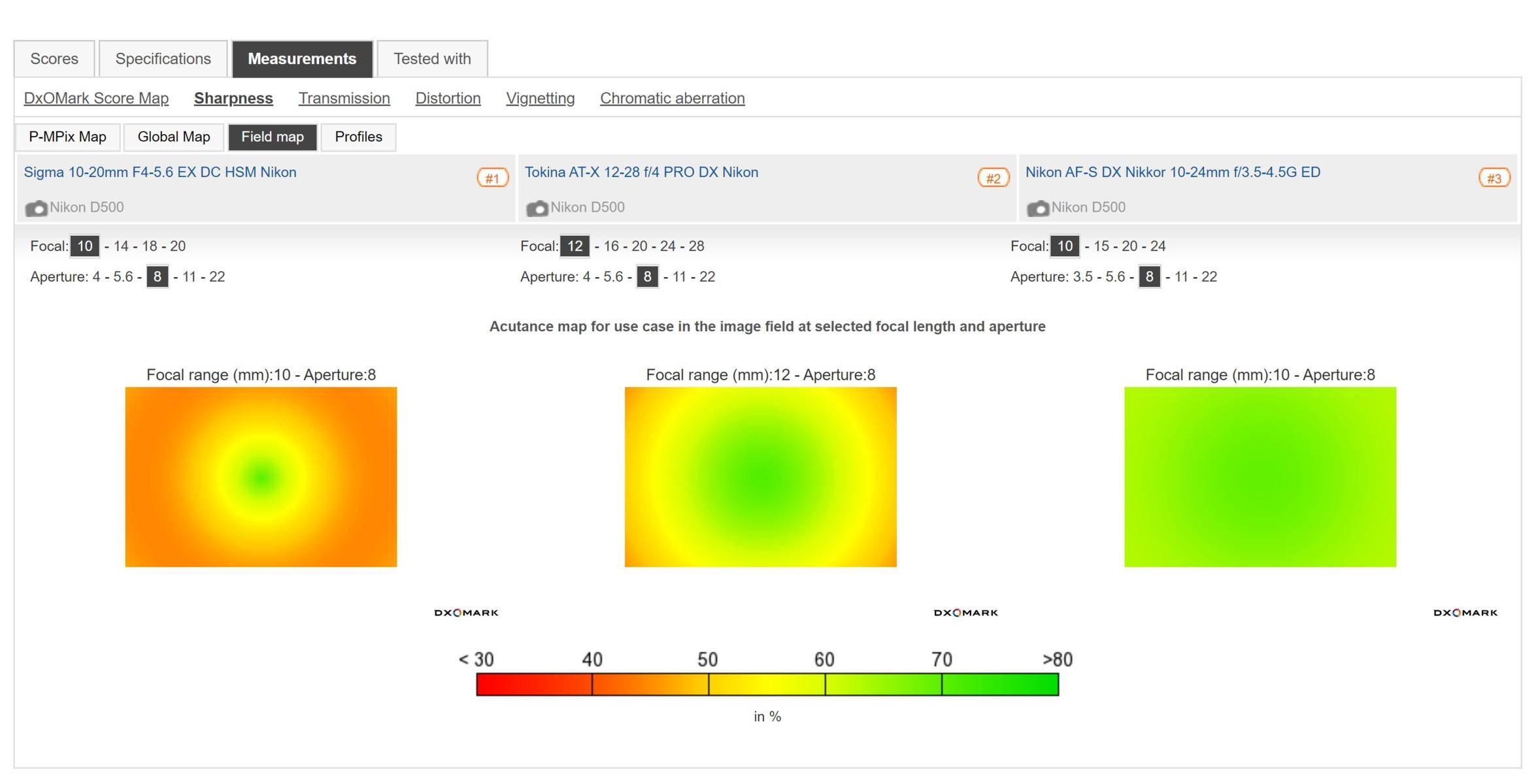

Der Kamerasensor ist allerdings nicht das einzige Problem. Letztendlich ist ein Foto das Resultat aus der Paarung zwischen dem Objekt und dem Kamerasensor.

Die Fertigungstechnik der Objektivhersteller hat sich in den letzten 20 bis 30 Jahren zwar deutlich verbessert, aber Sie konnte nicht mit der Entwicklung der Sensortechnik mithalten.

Daher können die hochauflösenden Sensor einer Sony A7 R Mark III oder Mark IV deutlich feiner auflösen, als es die meisten Objektive können.

Die Auflösungsgrenze liegt bei einem Spitzen-Objektiv bei circa 6 Mikrometer, wodurch die Grenze 24 Megapixeln wären.

Die Auflösung eines Objektivs variiert aber stark je nach Nutzung. Am äußeren Anschlag eines Zoom-Objektivs oder bei sehr stark geschlossener oder komplett offener Blende leidet die Qualität aller Objektive, wodurch die Auflösungsgrenze deutlich niedriger ist.

Eine Liste von häufig verwendeten Objektiven und ihrer Auflösung finden Sie hier:

Quelle: DXOMark

Auflösungen sind Laborwerte

Wie die Laborwerte oben zeigen, schaffen es viele Objektive gerade einmal 50% der Auflösung eines Kamerasensors zu erreichen.

Aber wie sieht es im täglichen Gebrauch aus?

Noch deutlich schlimmer!

Die meisten Hobby- und auch Profi-Fotografen nehmen ihre Fotos auf, während Sie die Kamera in der Hand halten.

Hierdurch entstehen 3 Probleme:

1. Verwackler durch den Fotografen

Es gibt Fotografen, die selbst bei langen Belichtungszeiten noch vermeintlich scharfe Fotos aus der Hand aufnehmen können. Aber selbst bei kurzen Verschlusszeiten verwackelt man, selbst wenn es nur wenige Mikrometer sind. Fotografiert man nicht bei strahlendem Sonnenschein, reduziert sich deshalb meistens die Auflösung durch Mikro-Verwackler.

2. Schlechte Bildqualität durch Bildstabilisatoren

Um den Mikro-Verwacklern den Kampf anzusagen, haben Kamerahersteller Bildstablisatoren entwickelt. Der Bildstabilisator erkennt ungewollte Kamerabewegungen und bewegt den Kamerasensor oder eine Linse im Objektiv und gleicht somit Verwackler durch den Fotografen aus. Die Stabilisatoren sorgen allerdings auch dafür, dass die Linsen nicht immer in perfekter Stellung zu einander stehen, wodurch die Bildqualität sinkt.

3. Verwackler durch die Kamera selbst

Die Kamera verwackelt das Bild? Ja, tatsächlich! Während der Aufnahme eines Bildes springt ein mechanisches Element, in der Fachsprache Verschluss oder Shutter genannt, vor den Sensor wodurch die Belichtungszeit gesteuert wird.

Dieser mechanische Verschluss verursacht im Moment des Hoch- und Herunterklappens eine Erschütterung in der Kamera. Diese Erschütterungen versucht die Industrie durch Dämpfer, leichtere Verschlüsse und sogar elektronische Verschlüsse zu eliminieren. Dadurch entstehen aber wieder neue Probleme.

Als Paradebeispiel der Fehlentwicklung ist hier zum Beispiel die Sony A7R Mark II zu nennen.

Durch das geringe Gewicht der Kamera, den hochauflösenden 36 Megapixel-Sensor und den sehr kräftigen Verschluss, weisen nahezu alle Fotos leichte Mikro-Ruckler auf.

Eine Lösung für das Problem gibt es. Man fotografiert vom Stativ und legt zusätzlich ein Gegengewicht wie z.B. einen Sandsack auf die Kamera.

In der Praxis ist das aber sehr umständlich, weshalb ich mich damals wieder von Sony und der A7R Mark II getrennt habe.

Wie viel Megapixel braucht man überhaupt?

Hochauflösende Kameras sind also nur in den seltensten Fällen sinnvoll und wie wir bisher geklärt haben liegt die maximal sinnvolle Auflösung bei circa 24 Megapixeln.

Aber braucht man 24 Megapixel überhaupt? Eigentlich nicht.

Betrachtet man die Statistik von den meistgenutzten Bildschirmauflösungen, findet man in den Top 10 Auflösungen von 640×360 bis maximal 1920×1080(Full HD).

Für Full HD benötigen wir abergerade Mal 2 Megapixel.

Und selbst bei 4K Bildschirmen mit 4096×2304 Pixeln, benötigen wir nur 9,5 Megapixel.

Der Drucker macht Druck

Aber wie sieht es mit gedruckten Fotos aus?

Hier kann es unter Umständen sinnvoll sein, eine hochauflösende Kamera zu nutzen.

Kunstdrucker, wie Sie für Reproduktionen von Kunstwerken genutzt werden, drucken heutzutage mit einer Druckerauflösung von 300 DPI.

Das bedeutet, dass 300 Bildpunkte/Pixel pro Zoll auf dem Papier aufgetragen werden.

Möchte man in dieser hohen Auflösung einen Druck im Format DIN A2 Format(40x60cm) erzeugen, benötigt man circa 34 Megapixel.

Dieser Anwendungsfall mag realistisch klingen, in den meisten Fällen ist er es aber nicht, denn bei gedruckten Fotografien spielt der Betrachtungsabstand eine entscheidende Rolle.

Um einen DIN A2 Druck als gesamtes Werk betrachten zu können, muss der Betrachter einen Abstand von ungefähr 1 Meter vom Kunstwerk einnehmen.

Das menschliche Auge ist nicht ohne Tadel, weshalb wir bei diesem Abstand schon lange keine einzelnen Bildpunkte sehen können. Die Auflösungsgrenze unseres Auges liegt bei 1 Meter ungefähr bei 100 DPI.

Bei 100 DPI Auflösung benötigen wir für einen DIN A2 Print allerdings gerade einmal 2363×1575 Pixel oder anders ausgedrückt 3,72 Megapixel!

Daher benötigen wir die 36 Megapixel wirklich nur, wenn man sehr große Bildformate drucken möchte und zugleich der Betrachtungsabstand sehr gering ausfallen wird.

November 11, 2021 at 9:34 /

Die komplexen technischen Sachverhalte sind hier sehr knackig und komprimiert beschrieben. Der Bericht hat mir sehr gefallen Herr Stibenz!

November 26, 2021 at 19:35 /

Vielen Dank! Freut mich, wenn ich Ihnen helfen konnte.

February 14, 2022 at 15:59 /

excellent !

March 11, 2022 at 10:36 /

Danke! Das ist so super beschrieben, dass auch ich als DAU es verstanden habe. Nun weiß ich endlich, zu was ich meine alte Digicam wenisgten noch nutzen kann.

November 7, 2022 at 11:41 /

Hallo Herr Stibenz,

vielen Dank für Ihre gute Ausführung bzgl. eines komplexen Themas.

Leider bin ich mir immer noch unsicher wie ich meine neue Kamera (Sony RX10 IV) optimal einstellen soll bzgl. Bildauflösung und Kompression. Angesehen werden die Fotos auf dem Mac in 4k, was ja einer Auflösung von 4096 × 2304 und 9,5 MP entspricht. Möchte keinen unnützen Speicherplatz verschenden aber natürlich die beste Bildqualität.

Ich schwanke zwischen:

– Auflösung L (20 MP; 5472 x 364820) in fein, was ungefähr eine Bildgröße von 7 MP ergibt nach einem Testfoto

– Auflösung in M (10 MP, 3888 x 2592) in superfein, was ungefähr einer Bildgröße von ebenfalls 7 MP ergibt nach einem Testfoto

Alternativ wäre natürlich noch die Auflösung in L mit superfein das höchstmögliche in JPEG

Ich wäre Ihnen unheimlich dankbar für eine Expertenantwort.

Viele Grüße

Hannes Wulf

November 7, 2022 at 11:57 /

… gerade noch Testfotos im Außenbereich gemacht statt im Büro.

Dort ergab ein Foto in M (10 MP) in superfein 12,2 MP, in L (20 MP) in superfein 17,8 MP und in fein 9,5 MP jeweils in JPEG und 3:2.

December 1, 2022 at 15:34 /

Gibt es denn nicht Kameras, wo man kleinere RAW Formate im normalen Fotoalltag verlustfrei benutzen kann – und beispielsweise 60 mpx nur wenn es die fotografische Situation als sinnvoll erscheinen lässt?

Können das Sensoren von hohen mpx Kameras leisten – und was wären die Nachteile davon?

Joachim Reichel

December 8, 2022 at 10:21 /

Hallo Joachim,

grundsätzlich funktioniert das und es wird auch von Herstellern angeboten.

Meines Wissens bietet Sony bei der A7 IV, A7R IV und Canon bei der neuen Eos R Serie eine S/M/L Raw-Funktion an.

Ein Nachteil dieser Technik ist das stärkere Rauschverhalten kleinerer Pixel, d.h. ein 60mpix Sensor rauscht bei gleichem technischen Stand mehr als z.B. ein 24mpix Sensor mit der gleichen Sensorgröße.

March 9, 2023 at 22:48 /

Nur wer die Grundprinzipien Digitaler Fotografie selbst begriffen hat, ist in der Lage, sie für andere nachvollziehbar zu vermitteln. Und das ist Ihnen mit diesem Beitrag zweifellos gelungen. Glückwunsch.